kontakt@swiatzwyklegoczlowieka.pl

Czy korzystanie z AI jest bezpieczne? To pytanie zadaje sobie coraz więcej osób, ponieważ Sztuczna Inteligencja (AI) przestała być mglistą technologią przyszłości. W 2025 roku to narzędzie, które budzi nas rano, dobiera trasę dojazdu do pracy, filtruje spam w skrzynce mailowej i pomaga pisać raporty w biurze. AI jest wszechobecna — w naszych smartfonach, bankach i urzędach.

Jednak wraz z jej rosnącą rolą w naszym życiu, w głowach użytkowników pojawia się coraz głośniejsze i ważniejsze pytanie: Czy korzystanie z AI jest bezpieczne?

Odpowiedź nie jest czarno-biała i brzmi: to zależy od tego, jak z niej korzystasz i jak bardzo jesteś świadomy potencjalnych zagrożeń.

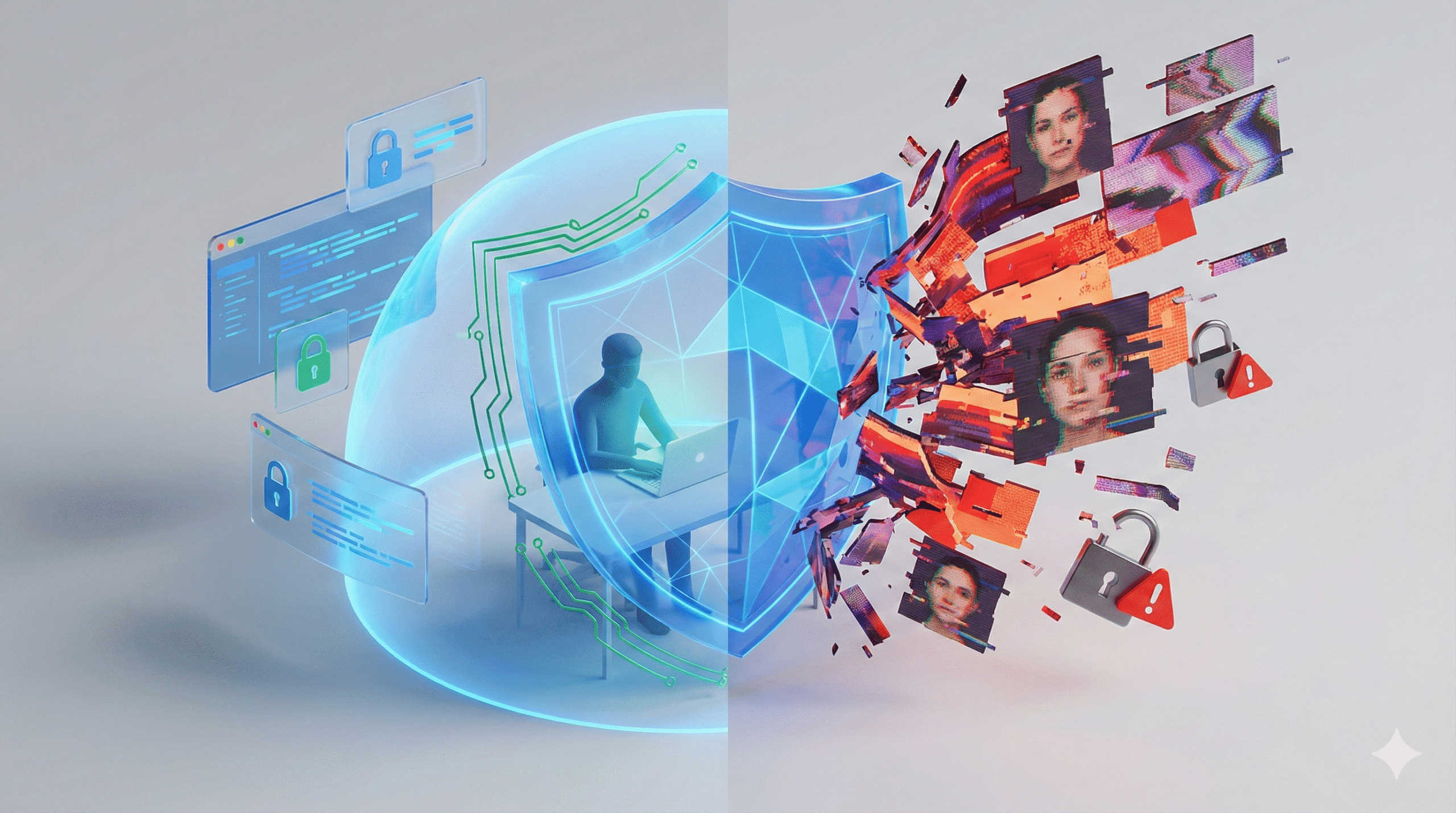

W tym dogłębnym artykule rozkładamy bezpieczeństwo korzystania ze sztucznej inteligencji na czynniki pierwsze. Obalamy hollywoodzkie mity, analizujemy twarde fakty i realne zagrożenia (takie jak deepfake czy wycieki danych) oraz dajemy Ci gotową instrukcję, jak poruszać się w cyfrowym świecie bez narażania swojej prywatności i finansów.

Spis treści

Co tak naprawdę oznacza „bezpieczne korzystanie z AI”?

Zanim ocenimy, czy korzystanie z AI jest bezpieczne, musimy zrozumieć, co to pojęcie właściwie oznacza w praktyce. W debacie publicznej często mylimy lęk przed „buntem maszyn” z realnymi problemami, które dotykają zwykłego użytkownika.

Eksperci w 2025 roku dzielą bezpieczeństwo systemów AI na trzy kluczowe filary, które bezpośrednio wpływają na Ciebie:

1. Bezpieczeństwo techniczne (Czy model działa poprawnie?)

To fundament zaufania do narzędzia. Czy model AI działa tak, jak został zaprojektowany, czy może jest podatny na błędy, które mogą Ci zaszkodzić?

- Odporność na manipulacje: Czy system potrafi obronić się przed celowymi atakami (tzw. adversarial attacks)? Przykładem może być sytuacja, w której cyberprzestępca tak modyfikuje obraz, że system bezpieczeństwa go nie rozpoznaje.

- Stabilność działania: Czy korzystanie z AI daje przewidywalne rezultaty w nowych, nieznanych sytuacjach?

2. Bezpieczeństwo prawne i etyczne (Czy jestem chroniony?)

Tutaj wchodzimy w strefę Twoich praw jako człowieka i obywatela. Czy technologia, z której korzystasz (lub która korzysta z Twoich danych), jest uczciwa?

- Ochrona prywatności: Czy Twoje dane wrażliwe (np. medyczne, finansowe), które udostępniasz podczas korzystania z usług AI, nie są wykorzystywane do trenowania modeli bez Twojej wyraźnej zgody?

- Brak dyskryminacji: Czy algorytm bankowy nie odrzuci Twojego wniosku kredytowego tylko dlatego, że został nauczony na historycznych danych, które faworyzowały inną grupę społeczną?

3. Bezpieczeństwo społeczne (Jaki ma to wpływ na nas wszystkich?)

To najszerszy kontekst.

- Dezinformacja: Czy korzystanie z mediów społecznościowych jest bezpieczne, gdy AI może masowo generować fake newsy i deepfake’i wpływające na demokrację?

Wniosek: Dopiero gdy system jest zabezpieczony na wszystkich tych trzech poziomach, możemy uznać, że korzystanie z danej AI jest w pełni bezpieczne dla użytkownika końcowego.

Fakty — co wiemy na pewno o korzystaniu z AI w 2025 roku?

Zamiast zgadywać, spójrzmy na twarde dane i obecny stan prawny, które determinują, na ile bezpieczne jest używanie nowoczesnych narzędzi.

Fakt 1: Europa stawia twarde granice (AI Act chroni użytkownika)

Unia Europejska wdrożyła AI Act – pierwszy na świecie kompleksowy system regulacji. Dla Ciebie oznacza to, że korzystanie z AI w Europie jest obarczone mniejszym ryzykiem niż w innych regionach świata.

- Systemy uznane za „wysokiego ryzyka” (np. używane w medycynie, rekrutacji, sądownictwie) muszą spełniać rygorystyczne wymogi: być transparentne, nadzorowane przez człowieka i oparte na danych wysokiej jakości.

- Praktyki takie jak social scoring (ocena obywateli przez państwo) czy biometryczna inwigilacja w czasie rzeczywistym są w UE co do zasady zakazane, co zwiększa Twoje bezpieczeństwo.

Fakt 2: Instytucje w Polsce działają na rzecz Twojego bezpieczeństwa

W Polsce rośnie aktywność instytucji zajmujących się cyberbezpieczeństwem (np. NASK, CSIRT KNF). Powstają darmowe przewodniki i ośrodki badawcze, które edukują społeczeństwo, jak bezpiecznie korzystać z nowych technologii. Świadomość zagrożeń rośnie, co jest naszą pierwszą linią obrony.

Fakt 3: Halucynacje to wciąż realny problem przy korzystaniu z AI

Modele językowe (LLM), takie jak ChatGPT, nie są bazami wiedzy – są zaawansowanymi silnikami prawdopodobieństwa. Mogą one „halucynować”, czyli generować odpowiedzi, które brzmią niezwykle przekonująco i profesjonalnie, ale są całkowicie zmyślone.

- Przykład zagrożenia: Korzystanie z AI do porady prawnej lub medycznej może skończyć się otrzymaniem nieistniejącego wyroku sądu lub błędnej diagnozy. Dlatego zasada ograniczonego zaufania jest kluczowa.

Najpopularniejsze mity o bezpieczeństwie AI (i dlaczego są groźne)

Błędne przekonania mogą uśpić Twoją czujność lub wywołać niepotrzebną panikę. Rozprawmy się z mitami, które zaburzają obraz tego, czy korzystanie z AI jest bezpieczne.

| Mit | Prawda | Dlaczego ten mit jest groźny? |

| „AI ma własną wolę i lada moment przejmie władzę.” | To science-fiction. Dzisiejsze modele to matematyka i statystyka. Nie mają świadomości, uczuć ani intencji. | Odwraca uwagę od realnych problemów, takich jak błędy w algorytmach czy wycieki danych. |

| „Korzystanie z AI jest bezpieczne, bo stoją za nią wielkie firmy (Big Tech).” | Nie do końca. Wielkie korporacje inwestują w bezpieczeństwo, ale ich produkty mają luki (bugi), a prawo często nie nadąża za wdrażaniem nowych funkcji. | Daje fałszywe poczucie bezpieczeństwa i skłania do bezrefleksyjnego powierzania danych. |

| „Nie używam ChataGPT, więc problem mnie nie dotyczy.” | Błąd. Nawet jeśli nie masz konta w żadnym serwisie AI, sztuczna inteligencja już Cię ocenia w banku, podczas rekrutacji czy profilując Cię w internecie. | Usypia czujność. Bezpieczeństwo AI dotyczy każdego, nie tylko bezpośrednich użytkowników. |

Realne zagrożenia: O czym musisz wiedzieć, korzystając z AI?

Zapomnij o Terminatorze. W 2025 roku prawdziwe zagrożenia związane z korzystaniem z AI są ciche, cyfrowe i wymierzone w Twój portfel, reputację lub prywatność.

1. Deepfake i wyrafinowana socjotechnika

To obecnie największe wyzwanie społeczne, które sprawia, że korzystanie z mediów i komunikatorów staje się mniej bezpieczne. AI potrafi sklonować głos Twojego bliskiego lub stworzyć wideo, na którym prezes Twojej firmy każe Ci wykonać pilny przelew.

- Zagrożenie „na wnuczka” 2.0: Oszuści dzwonią, używając głosu dziecka (wygenerowanego z próbki pobranej np. z TikToka), twierdząc, że miało wypadek i potrzebuje pieniędzy.

- Dezinformacja: Fałszywe, ale realistyczne nagrania polityków mogą wpłynąć na Twoje decyzje wyborcze, zanim prawda wyjdzie na jaw.

2. Prywatność i wyciek danych (Shadow AI)

Czy korzystanie z AI w pracy na własną rękę, żeby przyspieszyć zadania, jest bezpieczne? To zjawisko tzw. Shadow AI, które niesie ogromne ryzyko.

- Mechanizm zagrożenia: Jeśli wkleisz do publicznego czatu (np. darmowej wersji asystenta AI) poufne dane klientów, strategię firmy lub kod źródłowy aplikacji, te informacje mogą zostać „wchłonięte” przez model w procesie trenowania. Istnieje ryzyko, że w przyszłości model „wypluje” te dane innemu użytkownikowi w odpowiedzi na jego zapytanie.

- Zasada: Traktuj czat z AI jak rozmowę w zatłoczonym autobusie – nie mów nic, czego nie chciałbyś ujawnić publicznie.

3. Ataki na modele (Adversarial Attacks)

To zagrożenie techniczne, o którym mówi się rzadziej, a które wpływa na to, czy korzystanie z systemów opartych na AI jest bezpieczne. Cyberprzestępcy uczą się, jak „zatruwać” dane.

- Przykład: Niewielka, celowa zmiana w kodzie strony internetowej może sprawić, że model AI indeksujący treści uzna bezpieczną witrynę za spam lub odwrotnie – przepuści złośliwą stronę phishingową jako zaufaną, narażając Cię na atak.

4. Algorytmiczna dyskryminacja

AI może zautomatyzować i ukryć niesprawiedliwość. Jeśli system rekrutacyjny uczył się na CV z ostatnich 10 lat, gdzie w danej branży dominowali mężczyźni, może automatycznie obniżać ranking kobiet. To realne zagrożenie dla równości szans, sprawiające, że korzystanie z rynku pracy staje się mniej sprawiedliwe.

Jak regulacje sprawiają, że korzystanie z AI jest bezpieczniejsze?

Nie jesteśmy bezbronni wobec technologii. Prawo wreszcie dogoniło innowacje, zwiększając bezpieczeństwo korzystania z AI.

AI Act (Unia Europejska) – Twoja tarcza

To kluczowa regulacja, która bezpośrednio wpływa na to, czy korzystanie z AI jest bezpieczne dla obywateli UE.

- Przejrzystość (Transparency): Musisz wiedzieć, kiedy rozmawiasz z botem (chatbotem), a kiedy z człowiekiem.

- Oznaczenia: Treści generowane lub zmanipulowane przez AI (deepfake) muszą być wyraźnie oznaczone, abyś nie został wprowadzony w błąd.

- Zakazy: Zabronione są systemy AI manipulujące podświadomością lub wykorzystujące słabości grup wrażliwych (np. dzieci).

RODO (GDPR) a AI

RODO nadal obowiązuje. Masz prawo wiedzieć, jakie dane zbiera o Tobie AI. Masz też „prawo do bycia zapomnianym” – choć usunięcie danych już „zaszytych” w wytrenowanym modelu AI jest technicznie bardzo trudne, firmy muszą szukać rozwiązań, by to zapewnić.

Checklist: Jak bezpiecznie korzystać z AI? (Poradnik dla każdego)

Chcesz korzystać z dobrodziejstw technologii, ale spać spokojnie? Oto Twoja lista kontrolna na 2025 rok, która sprawi, że korzystanie z AI będzie bezpieczniejsze.

- Chroń dane wrażliwe jak ognia.Nigdy nie wpisuj do czatów AI: numeru PESEL, haseł, pełnych danych adresowych, wyników badań medycznych, informacji finansowych ani tajemnic firmowych.

- Stosuj zasadę ograniczonego zaufania.Zawsze weryfikuj informacje podane przez AI w zewnętrznych, wiarygodnych źródłach. Traktuj AI jako zdolnego stażystę, którego pracę trzeba sprawdzić, a nie jak nieomylnego eksperta.

- Uważaj na emocje i presję czasu.Jeśli otrzymujesz telefon lub wiadomość wideo (nawet od „znajomego”), która wywołuje silny strach lub presję (np. „wpłać pieniądze natychmiast”), zatrzymaj się. To może być deepfake. Zweryfikuj to, oddzwaniając do tej osoby tradycyjną metodą.

- Zabezpiecz swoje konta.Włącz dwuskładnikowe uwierzytelnianie (2FA) wszędzie, gdzie to możliwe, zwłaszcza w usługach AI, z których korzystasz.

- Korzystaj z oficjalnych i zaufanych narzędzi.Unikaj podejrzanych aplikacji typu „AI do wszystkiego za darmo”, które wymagają szerokiego dostępu do Twoich kontaktów i plików w telefonie. Sprawdzaj dostawcę usługi.

FAQ — Odpowiedzi na najczęstsze pytania o korzystanie z AI

P: Czy korzystanie z AI oznacza, że jestem podsłuchiwany?

O: Nie w sensie dosłownym (asystenci głosowi nie nagrywają wszystkiego w sposób ciągły, chyba że zostaną wybudzeni). Jednak firmy technologiczne używają AI do śledzenia i analizowania Twoich zachowań online, kliknięć i historii wyszukiwania, aby budować Twój profil reklamowy.

P: Czy AI zastąpi mnie w pracy?

O: Eksperci są zgodni: AI raczej nie zastąpi ludzi, ale ludzie potrafiący bezpiecznie i efektywnie korzystać z AI zastąpią tych, którzy tego nie robią. Traktuj to jako narzędzie, które zdejmuje z Ciebie rutynowe obowiązki.

P: Jak sprawdzić, czy zdjęcie lub wideo jest deepfake’iem?

O: Szukaj nienaturalnych detali: dziwnie wyglądających dłoni lub zębów (częsty błąd AI), braku mrugania, niesynchronicznego ruchu ust z dźwiękiem, nienaturalnego oświetlenia lub „rozmycia” na krawędziach twarzy.

Podsumowanie: Czy korzystanie z AI jest bezpieczne?

Sztuczna inteligencja jest potężnym narzędziem – jak ogień czy energia atomowa. Sama w sobie nie jest ani dobra, ani zła.

Odpowiedź na pytanie „Czy korzystanie z AI jest bezpieczne?” brzmi:

Tak, korzystanie z AI może być bezpieczne i niezwykle użyteczne, POD WARUNKIEM, że robisz to świadomie, dbasz o higienę cyfrową, weryfikujesz generowane treści i nie udostępniasz pochopnie swoich wrażliwych danych.

Ryzyko pojawia się tam, gdzie wkrada się niewiedza, automatyzm i nadmierne zaufanie do maszyny. Twoja świadomość jest Twoim najlepszym zabezpieczeniem w 2025 roku. Technologia jest dla ludzi, a nie odwrotnie.

Notka od autora: Wskazane w tym artykule zasady to podstawy bezpiecznego korzystania z AI. Należy pamiętać, że technologia wciąż dynamicznie się rozwija, a wraz z nią pojawiają się nowe wyzwania i sposoby na to, aby korzystanie z AI było bezpieczne. Regularne aktualizowanie wiedzy i świadomość nowych trendów są kluczowe w tej nieustannie zmieniającej się cyfrowej rzeczywistości.